Eine technisch einwandfreie Internetseite, ist die Basis einer guten Suchmaschinenoptimierung. In manchen Fällen kommt es bei der Umsetzung von Optimierungsvorschlägen allerdings zu Problemen: Das genutzte Content Management System erlaubt zum Beispiel keine Anpassungen oder die Entwicklungszyklen für neue Funktionen ziehen sich über Monate hinweg. Ähnlich wie man Trackingkonzepte ohne die Unterstützung der IT-Abteilung umsetzen kann, lassen sich auch bestimmte technische SEO-Arbeiten über den Google Tag Manager realisieren. In diesem Artikel zeigen wir euch, wo ihr dabei ansetzen könnt.

Inhaltsverzeichnis

Google und JavaScript

Früher war es noch einfach. Nur was im HTML-Quelltext stand (Rechtsklick -> Seitenquelltext anzeigen), konnte von Google gecrawlt werden. Inhalte, die dynamisch mit JavaScript geladen wurden, waren für Suchmaschinen nicht zugänglich. Im Jahr 2015 gab Google allerdings bekannt, dass die Suchmaschine in der Lage sei, JavaScript auszuführen und dessen Inhalte zu interpretieren. (Aus diesem Grund sollten auch JavaScript und CSS Dateien niemals vom Crawling ausgeschlossen werden.)

Da Google also in der Lage ist, auch das nachträglich eingebaute JavaScript des Tag Managers auszuführen, können wir HTML und JSON-Code, den Google für die Verarbeitung der Seite nutzt, über den Tag Manager nachtragen und verändern und so auch Angaben, die aus SEO Sicht wichtig sind, anpassen. Sehr sinnvoll ist dieses Vorgehen zum Beispiel bei der Auszeichnung von strukturierten Daten. Außerdem wertet Google auch durch JavaScript verändertes HTML für seine Suche.

SEO-Arbeiten mit dem Tag Manager und JavaScript umsetzen

Folgende SEO relevanten Angaben können durch den Tag Manager bereitgestellt oder verändert werden:

- Title-Tags

- Meta-Description

- Meta-Robots-Tag (Um z.B. die Indexierung von Seiten zu steuern)

- Canonical-Tags

- Mobile-Tags (nützlich, wenn eine mobile Version der Website besteht, wie z.B. m.example.de)

- hreflang-Attribute

Habt ihr also nicht de Möglichkeit, diese Angaben im CMS anzupassen, könnt ihr dies über den Tag Manager abbilden. Vorausgesetzt der Google Tag Manager Code ist auf der Seite eingebaut und das Konto richtig eingerichtet.

Das wohl umfangreichste Experiment zu diesem Thema, welches zurzeit im Netz verfügbar ist, wurde von SearchVIU durchgeführt.

Bei allen durchgeführten Tests hat Google die Änderungen des Google Tag Managers berücksichtigt. Allerdings dauerte es bei bestimmten Tests relativ lange, bis die Vorgaben umgesetzt wurden, da Google für JavaScript einen anderen Crawler nutzt. Dieser trifft zum einen seltener auf die Internetseite und muss zum anderen mehr Daten verarbeiten. Pro Session kann er daher weniger Unterseiten verarbeiten.

Die Nachteile beim Umsetzen von SEO-Arbeiten mit dem Tag Manager

Doch SEO-Angaben sollten grundsätzlich nur mit dem Google Tag Manager realisiert werden, wenn keine Möglichkeit besteht, diese direkt im System umzusetzen. Nur der Google Crawler kann JavaScript aus dem Google Tag Manager interpretieren. Außerdem ist das JavaScript-Crawling noch eine relativ neue Technologie. Google ist beim Crawling von JavaScript vielen Anbietern voraus. Die Crawler von anderen Suchmaschinen und von SEO-Software können nur selten mit JavaScript umgehen. Die Änderungen, die ihr über den Google Tag Manager vornehmt, können von anderen Suchmaschinen daher nicht interpretiert werden.

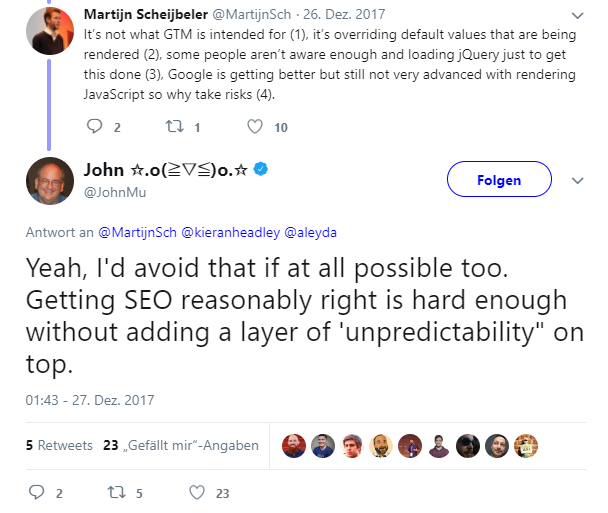

Hier findet ihr dazu nochmal das Statement von John Müller (Webmaster Trends Analyst bei Google):

Tutorial: Seiten auf noindex stellen

Um euch zu zeigen, wie ihr effektiv SEO mit dem Google Tag Manager betreiben könnt, zeigen wir euch an einem Beispiel, wie ihr dabei konkret vorgehen könnt. Wichtig ist natürlich, dass ihr den Google Tag Manager bereits auf eurer Website eingebunden und eingerichtet habt.

Durch das Deindexieren von doppelten und irrelevanten Unterseiten können große Websites stark von einer besseren Sichtbarkeit profitieren. Diese Methode solltet ihr sehr sorgfältig anwenden, da ihr unter keinen Umständen nützliche Seiten deindexieren wollt.

Ein Anwendungsfall ist zum Beispiel das Deindexieren von doppelten Inhalten, die durch Parameter entstehen. Gängige Parameter wie z.B. ?=search werden für gewöhnlich von Google als solche erkannt und können mit der Search Console gesteuert werden. Nicht erkannte Parameter könnt ihr mit dem Tag Manager über die Seiten-URL zuverlässig auf noindex stellen. Voraussetzung dafür ist, dass eine bestimmte Zeichenfolge in der URL besteht und sich das Problem nicht zeitnah im Content Management System lösen lässt.

Schritt 1: Doppelten Inhalte identifizieren

In unserem Beispiel ist uns bei einem Screaming Frog Crawl einer Website aufgefallen, dass sehr viele Unterseiten mit „(offset)“ in der URL gefunden wurden. Für Suchmaschinen waren diese Inhalte nicht von Bedeutung, da sie lediglich Duplicate Content verursachten.

Durch die Google Suchabfrage

Site:domain.com inurl:(offset)

fanden wir über 1,600 indexierte Seiten mit diesem Parameter. Bei einem genaueren Blick auf die Unterseiten konnten wir schnell feststellen, dass die Parameter durch die Filternavigation entstanden. Die Inhalte der getesteten Unterseite waren dadurch dreimal zu oft im Google-Index vertreten:

Um das Crawl Budget der Website zu schonen und den technischen Duplicate Content einzugrenzen, sollten sie nun deindexiert werden.

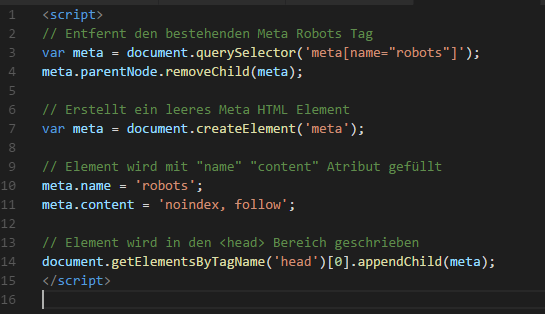

Schritt 2: Anlegen des „noindex“ Script Tag im Tag Manager

Im Tag Manager können wir mit dem „benutzerdefinierten HTML“ Tag Elemente auf der Seite modifizieren. Durch den folgenden JavaScript Code, wird der bestehende Meta-Robots-Tag entfernt und ein neuer „NOINDEX“ Meta-Robots-Tag eingefügt:

Schritt 3: Trigger erstellen

Damit unser kleines Script auf den richtigen Seiten ausgeführt wird, muss ein Trigger erstellt werden. In unserem Fall können wir die vorkonfigurierte Variable {{Page URL}} nutzen. Falls die Variable nicht verfügbar ist, muss diese wahrscheinlich noch unter der Variablen-Konfiguration aktiviert werden.

Der Tag soll auf jeder Unterseite gefeuert werden, die „(offset)“ in der {{Page URL}} verwendet.

Schritt 4: Crawling anstoßen

In unserem Fall werden die Seiten wahrscheinlich sehr selten von Google gecrawlt. Da es sich außerdem um relativ viele Unterseiten handelt, bietet sich das Einreichen einer zusätzlichen Sitemap.xml in der Search Console an, die die entsprechenden Unterseiten enthält. Dies kann die Deindexierung beschleunigen.

Hierzu könnt ihr mit dem Screaming Frog eine sitemap.xml mit allen Seiten erstellen, die „(offset)“ in der URL enthalten. Eine Anleitung findet ihr hier.

Wenn nur wenige Unterseiten betroffen sind, habt ihr die Möglichkeit, diese einzelne in der Search Console unter „Crawling -> Abrufen & Rendern“ einzureichen und so die Indexierung beschleunigen. Durch das Rendern wird automatisch auch das JavaScript ausgeführt und das Crawlen der Seite beantragt.

Wichtig: Die Seiten, die deindexiert werden sollen, dürfen nicht durch die robots.txt vom Crawling ausgeschlossen sein, da Google sonst nicht auf die Seite zugreifen kann und das neue Robots-Tag nicht liest.

Weitere Anwendungsfälle

Wie schon erwähnt, lassen sich auch strukturierte Daten gut mit dem Tag Manager auszeichnen. Mehr dazu findet ihr im Artikel „Strukturierte Daten mit dem Google Tag Manager bereitstellen“.

Wenn ihr eine mehrsprachige Internetseite mit funktionierendem Sprachen-Menü besitzt, könnt ihr über den Tag Manager relativ einfach gute hreflang-Attribute bauen. Eine ausführliche Anleitung findet man bei SearchVIU.

Fazit

Mit dem Google Tag Manager habt ihr die Möglichkeit, bestimmte SEO relevante Angaben auf eure Website zu verändern – ohne dafür ins Content Management System einzugreifen. Dies ist besonders praktisch, wenn solche Anpassungen nicht möglich oder mit sehr viel Aufwand verbunden sind. Ihr seid unabhängig von der IT und könnt eure Änderungen schneller umsetzen. Da aber ausschließlich Google diese so vorgenommenen Veränderungen interpretieren kann und der JavaScript-Crawler vergleichsweise lange braucht, um die Unterseiten zu crawlen, bietet sich diese Lösung nur dann an, wenn es keine andere Möglichkeit gibt. Lassen sich die Änderungen im CMS umsetzen, ist diese Variante immer vorzuziehen.

Habt ihr spezielle Fragen zum Tag Manager oder Suchmaschinen Optimierung? Nutzt gerne die Kommentar-Funktion, wenn wir euch behilflich sein können.

Weiterführende Informationen

- Vortrag von Rene Dhemant über Javascript Crawling

- Google um erneutes Crawlen von URLs bitten

<script type=“application/ld+json“>

{

„@context“: „https://schema.org“,

„@type“: „WebPage“,

„name“: „Technische SEO-Arbeiten mit dem Google Tag Manager umsetzen“,

„description“: „Erfahre, wie du Title-Tags, Meta-Daten, Canonicals, hreflang-Attribute oder Noindex-Tags mit dem Google Tag Manager implementierst, wenn dein CMS dies nicht zulässt.“,

„publisher“: {

„@type“: „Organization“,

„name“: „lunapark“,

„url“: „https://www.luna-park.de“,

„logo“: {

„@type“: „ImageObject“,

„url“: „data:image/png;base64,iVBORw0KGgoAAAANSUhEUgAAAXcAAACHCAMAAADa++lhAAAAwFBMVEX///+WkgBfXl6TjwBbWlqQjABYV1dUU1Pt7e1SUVGjo6OPigCHh4dZWFippj+5uLj39+zs69fW1ajh4ODNzc2cmBDAvnzd3La2s16inhzDwsLm5uZ9fHyemzD8/PZmZWVubW329vbX1tabm5unozDNy5ZzcnLf3r75+e/o586wsLB7enqdnJySkZGqqqqEg4O6uGyqp0zIxojOzJqrqEnr6tS9unG4tWOppkTt7N6opTbn5sjd3LnEwYCZlh2sqVaNmSzvAAAQiUlEQVR4nO2daWOiMBCGhXCoqEXrVQ8U69murdZ60EP//79aApIDEmoVC7W++2W1IOEhDJOZSUilopKx/CgtXmavb3cCVKVy1y/M19VFbbQ0IjvIVYSM90W1IGiaLANbAhb8CGRZ04RCdfBuXPFHJsMqVd9kCFwIFcQv91cLaxx3iy9A+qha+Bo5Db+yLllxt/tXy1rMhW8wx/Bl4XVQjLv1v1R67dWG/m3mCD1ovyzjPoffp1H9BOgI/dtCj/tEfpOsKjgVuoderk/iPpvfokldiwT6Hr3Wr8V9Rr9BH5tvUT9gWyBXFle3Ply1t68NDBwnabJQudv227a224r9pRzq4Mvb0pU8Xx+FcOoQuNDfrV5KI8vS9fHYsDXWdd2yrEltsJpXuPRt8nGfXVK1nIdRh8h3LyVLD+u4Y/19UN0IGuuH5P77j53KL5JR5VOHzKul4qGmwlgu6kAL9Hsgr69epV81QeZDf1t8fwT0PrgLdHsABmdo+i+W/qrxoIPX2rGPRONj7R98af3rGBarxDExsvBaOy24aMBxL3UhtZeIGv3rpb8yTQyQty9RhBWtQZu6rPL2OoKFqjHHPkDefUTlchsjylMC8iKiH/7FMmaszg7kWbRh3OWKdG/k9V9PjSzbDOwArKLPW+iknwr+uK0pMQaXQFudx83WVzjyA+S/PHz9DHqPQJufL0enr3Gf11ZnO0zSxfBj5MJ5DcDkDR1Tfv2boTKjEMAOhPPf/aWK1+XB9i9mv/W3gGn/mfiJvvasG6j8vdx3sR0IW1U+fujYNa/LA+GvuTXLih+7Vv85nxp1eQBGP3bQJGjpH6P+tF+38J4t8l8Cv/S77fL2py0tuvLa38mGLP2OjLz++UYYu30rtL9i44sB7PFkIz737QB/A7zue6QC4af8GL9qnrn7C+6kUfBhj9GJ3ntVoP8H8q47H/ZYz9nqu+DnFx8yqNLGPe4gydiNEcmzWFtxfpVo7Fr851uXY3y0/5Qmvt6ehFis2+Mv2psc+/zH+Hs7lAseXLCJ31DP1DhGSywZTrPAa9ztOJsWlJWRE3OiY8e1lS+1sIYep4J+3O3B0u/A5Y5bjT413beSpFKKotOk9kWaeJ/nnqyx+cSxNNW4m3EGvdPGPWnRV2dgkbhWRSAqr5fASrmVDDPdF2dpShoxAwYkxIOkBJ2ay/Np9OVosH7dwikwAPST2K2cQZ2crMdOVBpbk8Vqt01m7f8IWppN3K04o5LY26FgAkq7TjL+cRmwlKoSdyv+oJbw0fqXC4Xj0gv04pNqBi9YxhYk2Zc0y55u425KxPqAHT6xWe50RnWVeY67KVGrDhKc80tLoispF3dTopZld/jERgsumHtqBZIYPXJ1ydzHspDMOEbqsrmnBrIgJ3TQetHcDVg/Fncj2Lpo7k6HT2ZY8rK5jwVB/oy7EUxdNvfUC0hosOC73EfFJBUPfCnD0q2L4A7AdjMrvSfTaP4ifZd7xV0fXNgWqlf2J+gI7vuEtnaNbp+go7lfswon6co9Hl25x6MEczesItRh71YZw40nH7VabVQshi6AG1T6tlcu926b6QO3N9PpZvMWqpk2v3Ec097N2yER3J1FmY2x/Q99VVzM23CtfRkI2826FJY3Gk8G6/kWbqzBpbTh+trt+azGquyxiblqoq96/4YdBSZ/MvnO8L7xBft07+G+1e2IYl7JZDKq1Ok+5rLlZvhOjpoPra5NWex0e84PfcH9lhD8+QO4z9p7bbmziPU3b5ud/akItq4Eb0xfK5BvSbAdV2HGK5Aa1SuMhbPtXUA/uFR8Nr8/W9XNaprZjqp4BGwGeVWc8vOdZqMlqkoeb+/sIymqNLyh+32j03XVKbtf9J4l7ziZBvziC+439nH2ynRhXziAe92DwI/BooneoGB/Knqr9+yrp2t3wUVX2SsxGy8hrw6xr5Y/zZdV9mebceg+SIrol6Tm2H0+fS+pUmDz/U6KlKWxecdxuJs5Yk/1AO4PKt685VzSqLh7bCjuAHLnLTAMgvVfNZm3AvRe2ht9sSju6SE+Owpi5iHYYnOayTO39qSIxI1y4x1Hhdx71PU6gPtTBm89db86O/d3fgfWfN13xlkBmrxYAmWfSO5lbu8V1Wf/4/JWDN4ZfrkGJMi9kaE2+5p7lujtT6mf4V4KY0n1eKPu6+zAEw2eDGdg7k2ShiTlJeoiKF0afM9/Z0iueOBJ7j7sX3O/J7DfeF+el/snxu6+IdH3yASE2VgR2O1tQX83W9ma7doVagnhLYt7Hv1PUpVhbno/bXUyRJfOD8nm3pKdXVIyUreVg3rs2nuTSD1Tg7n3yv5L9hX3KdpBksro27NyF7ZoOoNW+CxNLKtY+yQXYgZ19BPENH1745d3Hbn5hr783OLbhiwaQ7TFvEc9d7N3qc3brIhNuELgMLu4YytK7qaHvHYzfftEPCWklp97/qmD/5rP286QFM7dbKEmSh3iiXFe7qivrwizXJxjxJpnNYj54nI/uLCYUcLLnml44JX1WekM7TWmp8Qt/sDaK/Mv6OyUu+hyqXtLcxN4GiiZTu4+m81OH0P9SHOI9lSG5KF+grs287mMeP4gmtYzwIul1v2/7qjI6vA0d/I+3usGG2PJO+00cZ16zGM9Ioh78+Tnnuk8YIjOzcLmnsZ3ltKiHjHn5y5XgpN+69jU7MdC+N7gzRUfoSuD6+Ap7sojY5CPwec9IA9oJw72VArTcu8fmrvSCVxfNvemiH7I8x89nZ07c+aphbjvFyt8x7twQwivqB3oQpLc1XvmXlN8o+9tEOrNCsOvd9Xw7JPi+n0Udz9CRyzutxh7Juvb/tzcOYV1c/SbrtFA6yMA/gThGlpYErWU4K7+Y+9loi3yLq80fqhyg2Am8o7c6l6SO/YFSTG496SQfc7MHXBCOojh3qOpB/tyQGgRBYAWacHcFVYndHSD/TjHJvc8yyNxd0mlWh4z1/EnuKsN5g5B7mXsyASfO+fmzlvydIk2aTuf7zRPIVlemTyII+y1P3L3MpHn5/a6BqpUf+Luk/rnuTTutcLc2b2dwZ243B1GaO788Rm2sIvveIU6EnePVAo9FNreN4i7GjLLAl8cB0m65ykkRvxEB9yw/+6305783B/w87zLCivHxR0xrBw+hQM1FVXB++KRbN0iBNLBWY0HPECFH+m4GEs+7jgk4/MfPcXFHR/38PIRtM/WGzkdxB0bGq7fGJAP9He545CMykk/xcX97gjud15D0D1yEPdU7mvH0S8MukF/PIg7HibnOV7Wb+EO84ap/pHcUVYqzIOh1TiFOw7JiEPO5snlPtaXtcFLtTpb714Lb30otMs3ud985fWY6Wav8fCUzf67n07dyCSyE9/m3nomnX2215lQ7tZHdV4BTtCY1LHccei2E/xjs/zvuSvZvqWiwBSoPxD/be4iHcVXOTnyxHE3RquNEHwzLqVvcscOjUr/Id2YDiXVl9im9X3utCSOpUkY9+LnNuQd6Edyb6L+niG/7k1F1Z9iipy7qLDDRoniPtl8zfwY7jgAiX3pm67yFfNTuPstlV8J4m7MmCnw0+17E4cFvSFqr8OuPYiKuzrFeSmRNS5ODnfrjs5rw1IlYbvtv3kqHM0d5Y+8/v7gy01LCix36hA6jbt6T46SWV5UYrhT7y+ykW/nn6MJXRj5dqT/HrAz/0jskip1n5/Kt01yPI8C8Edxd3KKT3jMygjqJIV7kcAOwHywZJSiHjtu8vszRGGFqIi5BsPVO4m74lr0FjZvPxwHPpy7cYexy2vOUOpY7j7/HUdoxbyYZQclT+HuRduJPK4UOEpCuBOZbv47dI7ljsersC4DWx376ccLUJ7AHUfbGzgEH/Dik8FdJzKD/HjNyfGZPPSl73EOgxdMP4U7mdee8g+VDO54+XkQsg7wsdxxPPKGSJ2GpAaj4m52cD2Bb8dkcEefQNgs+CO5E/H3Jnnzd0KyINFwT90StWe0iT+A+/rs3HX8UvOwqPCR3LE7Ax+r957RUULSq1FxJwrfUc2fK4I7bymj2dm544XQt9wdUkdzx8Wr0LwPPUBhKdnIuONiHVyC7Tt/wFsksIq4cxeZGp/GfRSsFGDpSO5dZGYgNGR0gr4doci4p4nSWHJf/B4bwHtj0yJYt+LXAJDgTuAeuvbycdzLyMw4tTAIAzNs4umkfBPn8GKHOOIKc99wZiuyChNp4RrqU7mHvdGlFKxBIOYdcHdD3d2tCMbdL2TWnomt0ancCb81TywtSZSdyxb7J5f40rAn4Q2I+rDj7DserPKrOmq4pUHu/Mzpg89/wZeBl4Kz1fJVYp/Cnai2J0z8hGDGM/B47Qgmxyox6DmO+xiXqXIX5iTfMBXkzi4GttXEsRm3mGCKE6G8Q5m4AD4C7uTsEqKQBJ+NADgdfh3m5ukbMnx7pP/+ho/Aro8cU5OfGNxFSWIVx+AYidR1v8H+e4ZTctcjkhZRcCdnUeLKqSoRB+QszogNfOCVrMaCfv38kdzJd2EySirHA/ooLO42x/vAk5JAqO4vS5oIz7DAN6dUbD4K7qlndP9IyMSTRdOg7+/P784tQGxRIbHopa1/Dt6RcTHyJ6r0tTUmVcF3FDZ3UZGylFtjPhH2ApUs3RO3/dR3pcxyTqWntUbCnYhM4nbMiK4EwGqCzlovDjaa47KT3VF+fZlYum5Zk8UO8cBm4kjuNbJkXpiVihZc28DQrdGqrQWyfxzuNnl1mHVniZnpXpbI5RFzBQgIYl6alr3lI8xmY9oJzIGNhDsRiRYVzxzqdIeVK6/rVXU1q2+2sH7FXSaTfI8cXBWrYj9qNZwNBYPtidxTa+opATN87fmmXSGXNQjzZ5AkRRW7w8fHrkjOiKSmaDTI1KqkKp1hK5d7hnswamCi4U7cZBKaSlvz2woyjeyeYtG3ie9SjYyT801GIXAI34RhMArJ89HTr/0zgDN0LcWTL7sq+ucMq88PkY2b9sKRSTyjsxRCdT//ImS2u1yxosivGvPQa6tt9LDxqnIjcpcbCK5PEAAf2D6yOIGnJrFEAXqc1/hlK15gdlJhbwKc93BHUscx4F5bIDtLsITFCZqpKWd9ArUbdDDLee7yBJL63IwwPoNETK/HQQ3bCeecs+ytgzxeMzYBcsG5HzjcQ94iifKpxJCgWGddf2AfxA2EetyBwIzP3D4rgT4vqR1m7bV5z1gyBW4uTp2r9H3uyr6yUuFwT029LaQ8MaFtNA+u/AKA1h5gp26ypusWgSzs9rlQXXCWRpJlDQZYiqDiSuBnMe4EbxvSdS2u4MOcaID9XG1XvaHUm7cPLy7Wm8Jlf/Y9Dy7gI+bKvORG+qmrUhVjUl6VWt76TI3MnpE7G/sGfeRyf2y5emTX5dlbtJAeyZBwcTAHZAWuJrdX7/RASv+YFQR5r8quhMe3RSRnO0/8pcR4E5qMycuu7zhNQLgr7FY1K2yfQDzS7GVzw46oZKTOMJcth65yZfaenjuSmlHVDNz8+Z5Y38psejIZH6OW/v5SXc03b/3NbvXywVyI13ap32ulRW1y2PJsR8mAwwPL0sdfLufGjAObcJ22tHkQITPdvO3BJeC+taDbmWQkcuVjlg7La18Vta7c49GVezy6co9HV+7x6Mo9Hl25x6Mr93h05R6Pfi33/zGufDtIkKBrAAAAAElFTkSuQmCC“

}

},

„datePublished“: „2019-06-12“,

„dateModified“: „2019-06-12“

}

</script>

<script type=“application/ld+json“>

{

„@context“: „https://schema.org“,

„@type“: „HowTo“,

„name“: „Seiten mit dem Google Tag Manager auf Noindex setzen“,

„description“: „Schritt-für-Schritt Anleitung, wie du doppelte oder irrelevante Seiten per Google Tag Manager auf Noindex stellst, ohne dein CMS zu ändern.“,

„totalTime“: „PT30M“,

„tool“: [

{ „@type“: „HowToTool“, „name“: „Google Tag Manager“ },

{ „@type“: „HowToTool“, „name“: „Google Search Console“ },

{ „@type“: „HowToTool“, „name“: „Screaming Frog (optional für URL-Listen)“ }

],

„step“: [

{

„@type“: „HowToStep“,

„name“: „Doppelte Inhalte identifizieren“,

„text“: „Prüfe mit einem Crawl (z. B. Screaming Frog) oder einer Google-Suchabfrage, welche URLs unerwünschte Parameter oder Duplicate Content enthalten.“

},

{

„@type“: „HowToStep“,

„name“: „Benutzerdefiniertes HTML-Tag im GTM erstellen“,

„text“: „Füge im GTM ein benutzerdefiniertes HTML-Tag ein, das den bestehenden Meta-Robots-Tag entfernt und einen neuen ‚NOINDEX‘ Tag einfügt.“

},

{

„@type“: „HowToStep“,

„name“: „Trigger konfigurieren“,

„text“: „Erstelle einen Trigger, der nur auf Seiten feuert, deren URL eine bestimmte Zeichenfolge (z. B. ‚(offset)‘) enthält. Nutze {{Page URL}} als Variable.“

},

{

„@type“: „HowToStep“,

„name“: „Crawling beschleunigen“,

„text“: „Reiche eine Sitemap.xml mit den betroffenen URLs in der Google Search Console ein oder nutze ‚Crawling -> Abrufen & Rendern‘, um die Deindexierung zu beschleunigen.“

},

{

„@type“: „HowToStep“,

„name“: „Überprüfung“,

„text“: „Prüfe in der Search Console unter ‚Abdeckung‘ bzw. ‚Darstellung der Suche‘, ob Google die Änderungen übernommen hat.“

}

]

}

</script>